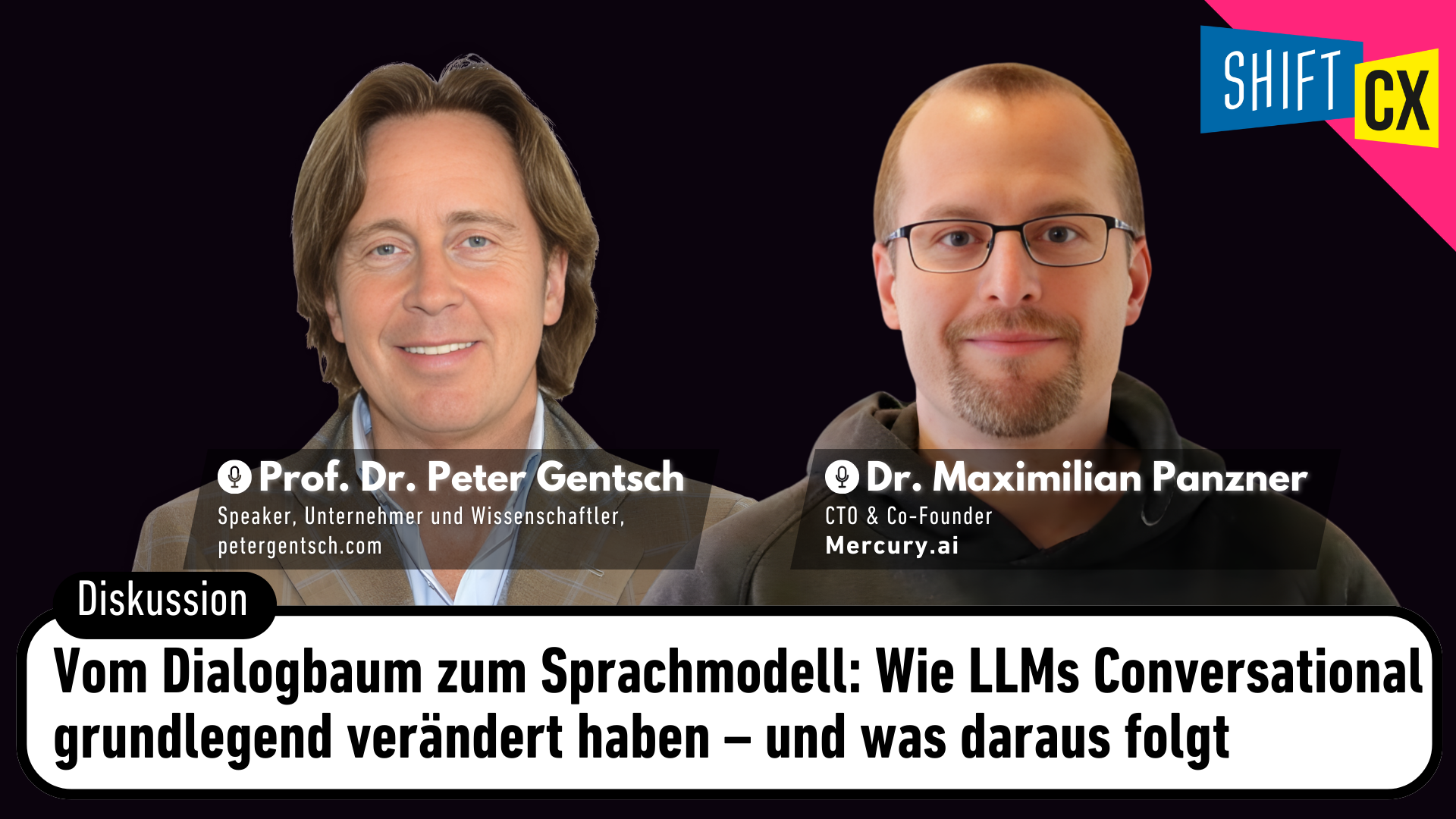

In der Panel-Diskussion der Shift/CX Konferenzwoche 2026 beleuchten Prof. Dr. Peter Gentsch und Dr. Maximilian Panzner die transformative Rolle großer Sprachmodelle (LLMs) in der Conversational AI. Der Austausch fokussiert auf die Integration von LLMs in bestehende Systeme, die Optimierung der Intent-Erkennung und Antwortgenerierung sowie die Herausforderungen bei der Datenvalidierung und im Wissensmanagement. Die Diskussion bietet einen tiefen Einblick in die technischen Architekturen und die Auswirkungen auf Teamstrukturen und Governance, wobei die Experten unterschiedliche Ansätze und Perspektiven zur Nutzung von LLMs in B2B-SaaS- und Technologieunternehmen präsentieren.

Die Experten diskutieren, wie LLMs eine tiefere Intent-Erkennung und empathische Antwortgenerierung ermöglichen, jedoch nicht alle klassischen Modelle ersetzen. Panzner betont die Bedeutung eines symbolischen, faktisch geprüften Zwischenschritts, um die Antwortgenauigkeit zu erhöhen, während Patruschew auf die Notwendigkeit von Guard Rails hinweist, um die Antwortqualität in regulierten Branchen sicherzustellen. Beide sehen die Notwendigkeit, spezialisierte Modelle und hybride Architekturen zu nutzen, um Effizienz und Wirtschaftlichkeit zu gewährleisten. Die Panelisten empfehlen, die Verantwortung für Wissensmanagement und Governance stärker in die Fachabteilungen zu verlagern und die Datenbasis iterativ zu verbessern, um die Leistungsfähigkeit von Conversational AI zu steigern.